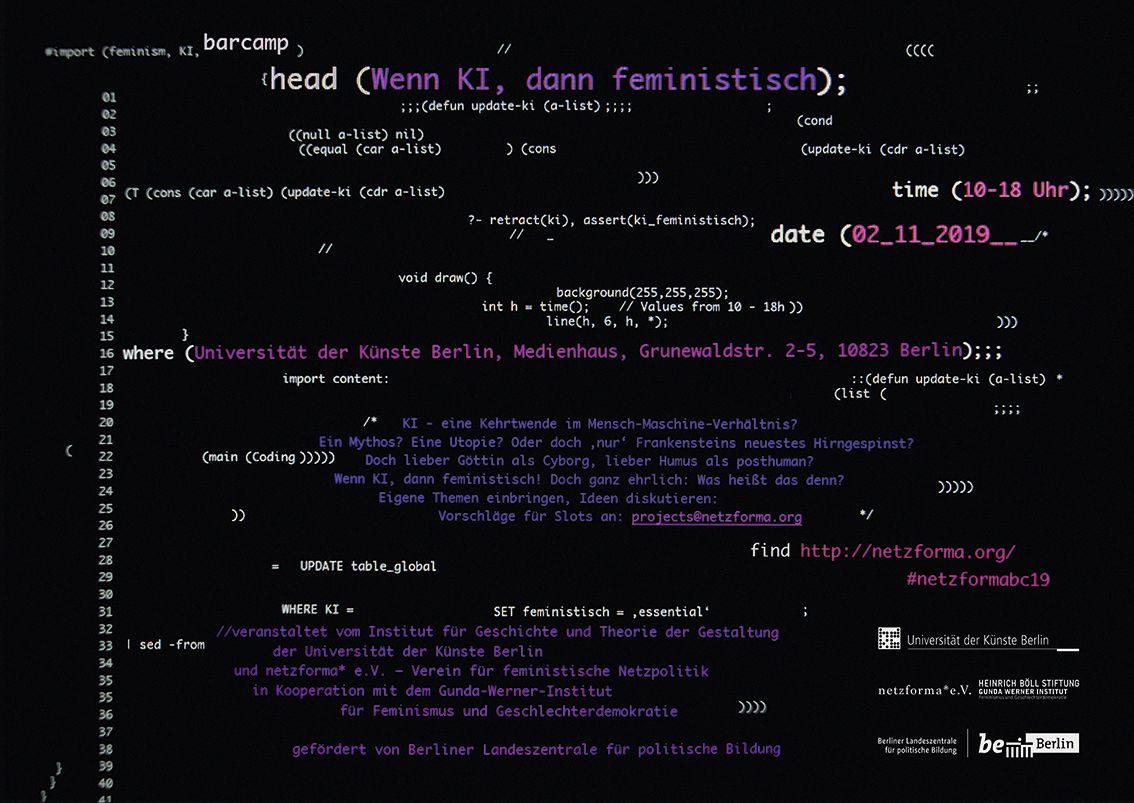

Die Veranstaltung „Wenn KI, dann feministisch!“ fand am 2. November 2019 in der Universität der Künste in Berlin mit ca. 150 Teilnehmenden statt. Das Ziel des Barcamps, angesichts sich verdichtender technischer und gesellschaftspolitischer Entwicklungen, war es neue Perspektiven und Antworten auf Künstliche Intelligenz und Algorithmen zu entwickeln. Dafür wollten wir einen offenen und diversen Raum schaffen, in welchem die Folgen und Chancen von Künstlicher Intelligenz ganz konkret aus einer feministisch-intersektionalen Perspektive diskutiert werden konnten. Mittelpunkt der Diskussion bildeten die sich aus algorithmischen Systemen ergebenden Gefahren für die Gleichberechtigung zwischen den Geschlechtern, aber auch mit Hinblick auf ihre Verwobenheit mit weiteren gesellschaftsrelevanten Merkmalen Gender, race, Klasse, Religion, Bildung, Herkunft sowie unterschiedliche körperliche Größen und Formen.

Sparkling Input

Der einführende Vortrag von Nushin Yazdani (KI- und Ethikforscherin), bot zu Beginn der Veranstaltung eine detaillierte inhaltliche Einführung in das Thema Künstliche Intelligenz (KI). Nushin Yazdani legte dabei den Fokus auf die sich in algorithmischen Systemen (AS) ausbildenden Herrschafts- und Machtstrukturen sowie die damit einhergehenden vielfältigen und intersektionalen Diskriminierungsformen. Der Vortrag machte die Relevanz feministischer, intersektionaler Perspektiven und deren Einbeziehen in die Entwicklung und Regulierung Künstlicher Intelligenz anhand theoretischer Einordnung wie auch praktischer Beispiele deutlich und stellte vor allem Fragen wie Worüber reden wir, wenn wir über KI sprechen? Werden feministische Betrachtungsweisen und intersektionale Zugänge berücksichtigt oder traditionell patriarchale Sichtweisen fortgeschrieben? Reicht es aus, KI gerechter zu gestalten? Wenn ja, nach wessen Kriterien?

Nushin Yazdani

Workshops

Verschiedenen Expert*innen aus Politik und Zivilgesellschaft haben einen Input gegeben und zusammen mit netzforma* den jeweiligen Workshop betreut: Chris Köver (Mitbegründerin des Missy Magazine und Journalistin bei netzpolitik.org), Julia Krüger (netzpolitik.org), Dr. Nakeema Stefflbauer (Gründerin von FrauenLoop), Anne Roth (Netzpolitik-Referentin der Fraktion DIE LINKE im Bundestag), Katrin Fritsch und Helene von Schwichow (MOTIF – Institute for Digital Culture) und Natalie Sontopski (Code Girls). Ziel war es durch den Input von Expert*innen eine Vertiefung zu spezifischeren Themenbereichen im Kontext von Künstlicher Intelligenz zu generieren. Gemeinsam wurden in den jeweiligen Workshops Ideen und Konzepte für einen feministischen und demokratischen Umgang mit Künstlicher Intelligenz entwickelt.

Mythos Transparenz

Der Begriff Transparenz in Bezug auf algorithmische Systeme umfasst sowohl den Quellcode (insbesondere für Fachleute) sowie Einblicke in die Logik der algorithmischen Systeme (AS) (für Fachleute, sowie für Nutzer*innen von spezifischen AS, etwa bei der Google Suche). Leitend für den Workshop war die Frage Was müsste sich ändern, um die Entscheidung der AS nachvollziehen zu können? – z.B. die Gründe bei einer Ablehnung eines Kredits. Transparenz wird hier als sinnvoll erachtet, wo AS individuellen (Ablehnung eines Kredits) und gesellschaftlichen Schaden (Existenz von Bias in Algorithmen) umgehen. Hier spielt insbesondere eine politische Gestaltung eine zentrale Rolle: Die User*innen sollten nicht in der “Holschuld” sein, sondern die Unternehmen in der Verpflichtung, Dritte zu informieren, welche Daten wofür gesammelt werden. Hier scheint eine staatliche Schutzpflicht sinnvoll (eine Art Aufsichtsbehörde, wie z.B. im analogen Beispiel der Apotheke/Medizin), die den Staat als Innovationsmotor fordern, um den Druck von der Zivilgesellschaft zu nehmen.

Feministische Technik- und Gesellschaftstheorie

Anne Roth, Netzpolitik-Referentin der Fraktion DIE LINKE im Bundestag, machte deutlich, dass eine feministische Technik- und Gesellschaftstheorie nicht ganz vorne anfangen muss. Hier sind das 1985 von Donna Haraway verfasste Cyborg Manifest sowie das Venus Matrix Manifest des Old Boys Network (OBN) ganz zentral. Kurz gesagt: Wir können unseren Kampf in den historischen Kontext einordnen. Anne Roth und netzforma* haben hier versuchten eine positive Sicht auf Künstliche Intelligenz und algorithmische Systeme zu werfen. AS können beispielsweise nützlich sein, aufzuzeigen wenn Gremien nicht divers besetzt sind oder Veranstaltungen männlich dominiert sind. Somit sind AS nicht generell nur als Machtinstrumente zu verstehen, sondern könnten auch als Gerechtigkeitsmotoren eingesetzt werden. Dies erfordert allerdings ein diverses Team an Programmierer*innen, gute Datensätze und ausreichend finanzielle Ressourcen.

Feministische Netzpolitik

Wie sehen aus einer feministischen Perspektive konkrete politische Programme und Forderungen in Bezug auf Regulierungsszenarien aus? Diesen Komplex diskutierten wir im Rahmen eines Weltcafés mit der Expertin Julia Krüger von netzpolitik.org. Neben einer umfangreichen Diskussion über das jüngst erschienene Gutachten der Datenethikkommission mit Blick auf KI, ging es in den Kleingruppen vor allem um eine nähere Definition und Ausgestaltung der im Gutachten aufgeführten Bedingungen für Einsatz, Implementierung und Weiterentwicklung von KI. Was bedeutet Transparenz und wo setzt diese an? Wer schreibt den Code, wer bestimmt den Datensatz selbstlernender Systeme und nach welchen Kriterien wird dieser zusammengesetzt? Welche Bereiche sehen wir als begründet schützenswerte, und deshalb notwendigerweise KI-freie Bereiche (z.B. Gerichte und Strafverfolgung). Insgesamt wurde deutlich, dass dieser Bereiche schon auf nationaler Ebene vielschichtig und komplex ist und dringend in einem breiten gesellschaftlichen Diskurs vertieft werden muss.

Neue Technologie, alte Stereotype: Gender Bias bei KI

Die meisten Sprachassistent*innen sind weiblich markiert – entweder durch ihre Namen und/oder ihre Stimme. Damit sind die Sprachassistent*innen, die an sich keinen humanoiden Körper haben, trotzdem eindeutig gegendert. Ziel des Workshops war es, in Kleingruppen zu überlegen, wie dieser Geschlechtszuordnung und der damit einhergehenden Stereotypenbildung begegnet werden kann. Wir haben in verschiedenen Ansätzen versucht, die Stimme neu zu denken: Etwa indem keine vorprogrammierte Stimme verwendet wird, sondern diese jeweils eingestellt werden muss bzw. eine genderneutrale Stimme (z.B. Computerstimme) verwendet wird. Insgesamt zeigt die Problematik der Stimmen von Sprachassistent*innen jedoch, dass es, um größere, strukturelle Probleme der Geschlechterstereotype geht .

Feministische Künstliche Intelligenz

In ihrem Vortrag schuf Dr. Nakeema Stefflbauer Bewusstsein dafür, dass algorithmische Systeme weder neutrale noch reflexive Entscheidungsinstrumente sind. Somit können sie immer, vor allem bei unreflektiertem Einsatz, diskriminierende Auswirkungen haben. Um dem entgegenzuwirken, ist es daher wichtig, die Diversität der Gesellschaft nicht nur anzuerkennen, sondern auch zu berücksichtigen – insbesondere mit Fokus auf Gender, race, Klasse, Religion, körperliche Größen und Formen in algorithmischen Modellen, Datensätzen und Systemen. Dr. Stefflbauer machte anhand empirischer Beispiele, wie etwa anhand von Gesichtserkennungsalgorithmen, deutlich, dass Künstliche Intelligenz niemals unabhängig vom gesellschaftlichen Kontext gedacht werden kann. So lange kapitalistisch-patriarchale Strukturen existieren, müssen wir neue technische Entwicklungen immer auch in diesen Kontext betrachten und bewerten.

Feminist Futures

Der Workshop wurde von Katrin Fritsch & Helene von Schwichow von MOTIF – Institute for Digital Culture, einem unabhängigen Thinkthank an der Schnittstelle von Technologie und Kultur, geleitet . Basierend auf ihrem Workshop Artificial Intelligence and Ethics nutzten sie den Workshop, um eine feministische (Dys-)U-topie zu entwerfen. Dabei identifizierten sie zuerst Problemfelder und entwickelten davon ausgehend feministische, positive Alternativen, vor allem im Bereich der individuellen und gesellschaftlichen Bildung. Daraus entwickelten sie dann das Konzept des Bildungs-all-in-chip.. Ein technisches Artefakt, dass allen Menschen die gleichen Bildungsmöglichkeiten durch die Nutzung von Künstlicher Intelligenz eröffnet.

CODONAUT – Ein interaktiver Film von Felix Pauschinger

Während der gesamten Veranstaltung hatten die Teilnehmer*innen die Möglichkeit, den interaktiven Film “Codonaut” von Felix Pauschinger zu schauen. „Der Codonaut erkundet, wohin wir uns programmieren – welche Welt wir mit der Erschaffung künstlicher Intelligenz entstehen lassen. Gegenwärtig und in der Zukunft. Wir erlauben es der Rezipientin (= der Codonautin), sich einen eigenen Weg durch den Kosmos der Informationen rund um das Thema KI zu suchen. In dem Tempo, das der Codonaut als richtig fühlt. Unterstützt wird sie dabei von der Künstlichen Intelligenz der Korsakow – Software, die inhaltliche Kontexte herstellt. Klassische, auch journalistische Erzählungen folgen in ihrer Gesamtheit einem Spannungsbogen. Spannung wird über gegensätzliche Pole erzeugt. Einem Schwarz oder Weiß, einem Gut oder Böse. Diese – auch im Wortsinn – Polarisierung erschwert jedoch den nötigen gesellschaftlichen Diskurs zum Thema Künstliche Intelligenz. Dort, wo es nur Gut oder Böse gibt, bleibt kaum Raum für Zwischentöne. Korsakow ermöglicht es uns, als Autoren eine wesentlich neutralere Position einzunehmen, als im klassischen Dokumentarfilm oder Feature. Bei Codonaut soll es weniger um die Präsentation spektakulärer Techniken gehen. Vielmehr sind uns die gesellschaftlichen, philosophischen und sozialen Implikationen wichtig”

Felix Pauschinger – http://about.codonaut.de/

Abschlussperformance

Die Performance “we have many names” der Künstlerin Olivia Hyunsin Kim bildete den Abschluss der Veranstaltung. In ihr stellte Hyunsin feministische Gesellschaftsperspektiven in den Vordergrund. Gemeinsam mit dem Publikum machte sie BIPOC-Frauen* und ihren Einfluss auf die Entwicklung von Technik, KI und Algorithmen sichtbar. Durch ein aktives verteilen der Namen dieser Frauen* im Raum wurde eine Auseinanderstzung angestoßen und der Raum mit diesen Geschichten eingenommen.

Kunstausstellung Wenn KI, dann feministisch

Die Kunstausstellung, kuratiert von Dr. Katrin Köppert, zeigte Kunstwerke von Andy King, Iyo Bissek, Klara Kirsch, Astrid Kraniger, Cammack Lindsey, Melissa Lücking und Alix Stria, Studierende und Künstler*innen der Universität der Künste. Damit bot sie den Teilnehmenden die Möglichkeit, sich auf ästhetischer Ebene dem Thema Künstliche Intelligenz anzunähern. Aufgrund des großen Erfolgs der Ausstellung blieb diese noch für sieben weitere Tage geöffnet. Die Ausstellung wurde insgesamt von ca. 300 Besucher*innen besichtigt.